さて、4年ぶりにiPhoneを機種変更、iPhone 14 Proを入手したぞ! 前に使っていたのがiPhone Xsなので色々とびっくりだ。とりあえずiPhone 14 Pro自体のレビューに関しては色々ともう語られていると思うのであえて自分が書くことはない気がするが、ちょっとだけ感想を書いてみようか。

まずはFaceIDがマスクつけてても使えるようになったのは嬉しい。マスク付きだと眼鏡は別途登録が必要みたいだし、暗い場所では使えないみたいだけど(つまりより細かい凹凸データを利用しており、なおかつ可視光映像も判定に使っているということだろうな)。

あとは、LiDARがついたiPhoneはこれが初めてということで、早速Metascanなどの3Dスキャンアプリなどで遊んでいたりする。メシグラメトリも可能だ。日吉の「とんかつ和栗」の上ロース、美味そうだろ? ああ美味いぞ!

このFaceIDやLiDARの背後で働いているのが赤外線レーザの光だ。iPhone Xsの時もFaceIDとフロントカメラのポートレートモードを観察した記事を載せたのだが、この新しいiPhone 14 Proでもやってみようと思う。ちなみにXsの時の記事はこちら。

今回は内容を動画1本にまとめてみた(最近Premiere Proの使い方に慣れて来たのでこういうのが楽になった)。

…のだけれども、古い人間なのでやはり文章が書かれてないと落ち着かないし読むならそっちが早いだろうと思うので、文章でもまとめておく。

撮影機器

赤外線動画の撮影には、結構古いYashica F537IR(赤外線ライトを外し、可視光除去のためにIR76フィルタを貼り付ける改造済)というトイカメラ的な赤外カメラを利用した。

赤外線を植物が強く反射したり、水や青空が赤外線では非常に暗くなるなどの、赤外線写真が短時間の露出で撮影できる上に赤外線動画も撮影可能。

まあ当時からトイカメラ的扱いで画質も低いし(動画は480p)流石に古くなっているのでアレだけれども、まあほどほどに赤外線を観察するには今でも使える優れものだ。iPhone 14 Proとこのカメラの両方を三脚に固定して動画を撮影した。

これを使って、FaceID、ポートレイトモード(フロントカメラ)、ポートレイトモード(リアカメラ)、フォトグラメトリ(Metascan)、シネマティック動画の順に、様子を見てみよう。

FaceID

まずは暗い部屋でFaceIDの様子を観察してみた。フロントカメラ横のTrueDepthカメラから結構強い赤外線が間欠的に出ている。この間欠性が、FaceIDを使ったときの妙に時間がかかる時と一瞬で反応する時の違いに関わっていたりするのかな?

前に紙を置いてパターンを見てみると、どうやら非常に密度の濃いパターンが見られるようだ(この精度の解像度ではパターンがほぼ分からないくらい)。ポートレイトモードなどに比べて、FaceIDは認証を司るだけあって、より細かい凹凸を知る必要があるため、このような仕組みをとっているのだろう。

これはiPhone XsのFaceIDを観察した時と、ほとんど変わっていない。

ポートレイトモード(フロントカメラ)

フロントカメラのポートレイトモードは、間欠的ではないレーザーのパターンが照射されている。

これも紙をかざしてみると、FaceIDよりははるかに粗いパターンのレーザーが出ていることがわかる。ポートレイトモードにはこのくらいの密度で十分、ということかな(その分、速いFPSでの動画撮影ができたりするのだろうし)。

これもiPhone Xsとあまり変わりないが、さらにいうとこのパターンはXbox360用Kinect(人間の動作でゲームをコントロールするためのデバイス)のパターンともとても似ている。

これは10年以上前の、Yashica F537IRを買ったばかりの頃に撮った動画だが、Kinectさんの後継者もいつの間にか色々な用途に使われるようになったんだなぁ。

ポートレイトモード(リアカメラ)

リアカメラのポートレイトモードを有効化すると、ちょっとフロントと違う感じのパターンが壁に映し出される。

紙をかざすとこんな感じ。フロントよりも整った格子状のレーザーが出ていることがわかる。

こちらのiPad ProのLiDARに関する記事に詳しい、VCSELの8×8をさらにDOEという光学部品で回折させて3×3倍に増やし、都合24×24の赤外線レーザのアレイにしている、という形がそのまま見て取れている。面白い。

しかし未だに光が戻ってくるまでの時間を測定して距離を測るというdToFの原理が俄に信じられんのだよなー。凄いな。

フォトグラメトリ(Metascan)

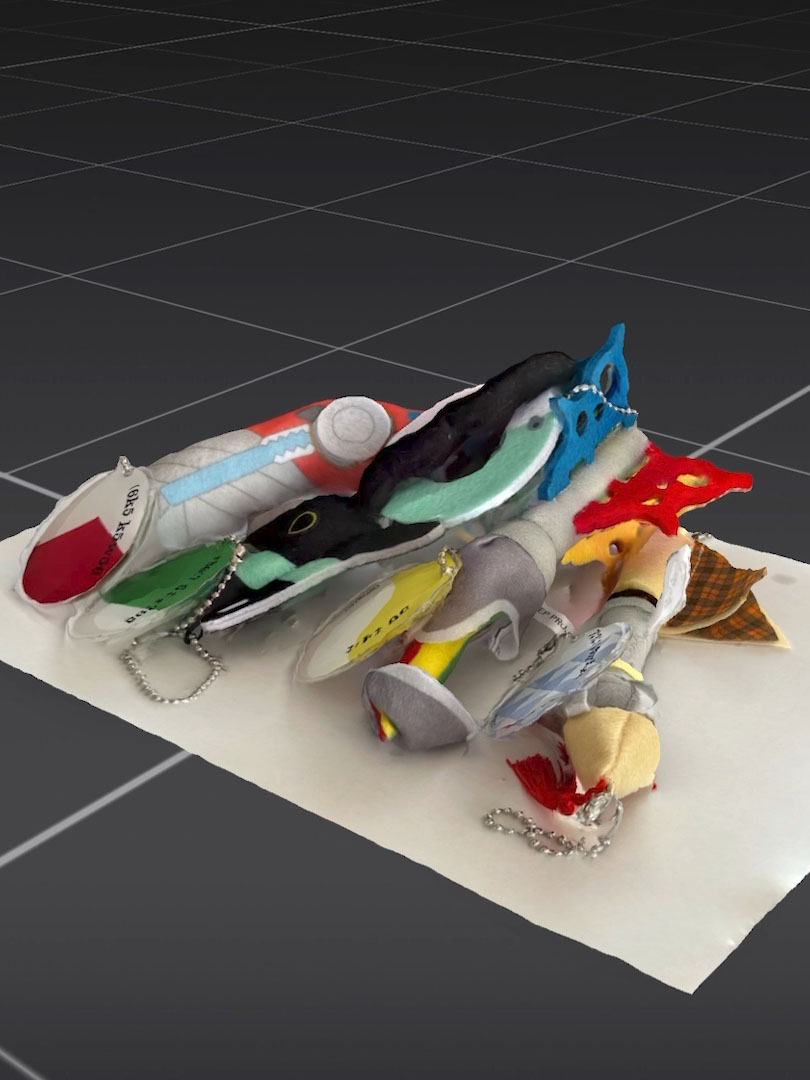

そんなわけで頭のアニメーションGIFでも紹介したフォトグラメトリだ。フォトグラメトリは必ずしもLiDARを必要とするわけではないが、LiDARがあると非常に精度が向上する。ということでMetascanというアプリを用いて、某ワンエグのぬいぐるみをスキャンしてみた。

ちなみにMetascanはこちら。

スキャンはMetascanのPhotoモードで行った。今回は明るい場所で撮影している。先ほどのLiDARの24×24の赤外線レーザーのアレイがぬいぐるみの上に照射されていることがはっきりとわかる。

動画で見れば一目瞭然なのだが、ぬいぐるみの質感まで感じるリアルなスキャン結果が得られているのはまさにLiDARのおかげなんだろうな。

シネマティック動画

同様にシネマティック動画にもLiDARが使用されている。

かつてのLytroとは全く原理が違うのだけれども、後からピントを調整できる動画が撮影できるのはとても面白い。っていうかそもそもボケって何、ということを思ってしまうよねこういうのは。

というわけで、赤外線カメラで見るiPhone 14 Pro、なかなか面白かった。ちなみに、Oculus Quest/Quest2のコントローラも赤外線で位置の把握をしていて、これも赤外線カメラで観察すると面白い。こちらの記事を参照していただければと。

しかしこの赤外線カメラ、買った時は7000円弱だったのに、その5倍以上の値段で中古が売られているってどういうことよ。流石にそこまでの価値はないぞ、多分(いや、俺も未使用のやつを1台まだ持ってたりするんだけどさ)。

![YASHICA 赤外線ナイトモード搭載 6×IR デジタルカメラ EZ Digital F537IR ブラック [35241] YASHICA 赤外線ナイトモード搭載 6×IR デジタルカメラ EZ Digital F537IR ブラック [35241]](https://m.media-amazon.com/images/I/41bOOMZfWGL._SL500_.jpg)